O ChatGPT é um poderoso assistente de IA(nova janela) usado diariamente por milhões de usuários todos os dias, mas é seguro usá-lo? Ele pertence e é operado pela OpenAI, uma das maiores empresas de tecnologia do mundo. E, como muitas plataformas de Big Tech, a OpenAI coleta grandes quantidades de dados de usuários. Esses dados não são protegidos com criptografia de acesso zero, portanto a empresa pode divulgá-los a parceiros comerciais (incluindo empresas de publicidade e análise), ao governo e a hackers em caso de violação de dados.

Nos bastidores, os modelos de linguagem de grande porte (LLM) da OpenAI estão aprendendo constantemente com o que você digita. Perguntas sensíveis, como sobre sintomas de saúde, questões jurídicas ou propriedade intelectual, podem alimentar sistemas complexos de criação de perfil ou ajudar a treinar modelos de IA usados muito além da sua intenção original.

As preocupações sobre como empresas de IA lidam com dados de usuários estão crescendo. Em março de 2026, mais de 2,5 milhões de usuários(nova janela) se comprometeram a deixar o ChatGPT depois que uma parceria controversa com o governo dos EUA levantou questões sobre como sistemas de IA são implantados e governados. É um lembrete de que, quando você interage com um assistente de IA sem fortes proteções de privacidade, pode estar compartilhando mais informações do que imagina.

- O ChatGPT é seguro? Os riscos de usar IA como ChatGPT e outras Big Tech

- Coisas que você nunca deve compartilhar com o ChatGPT

- Como se manter seguro ao usar o ChatGPT

- Mude para um assistente de IA privado

O ChatGPT é seguro? Os riscos de usar IA como ChatGPT e outras Big Tech

Antes de escolher ferramentas de IA como ChatGPT, Gemini, Meta AI, Copilot e DeepSeek, vale a pena entender seus riscos de segurança e de privacidade:

| Risco | Impacto potencial | Por que isso importa |

| Coleta de dados e registro | Prompts, uploads de arquivos e padrões de interação podem ser armazenados | Pode ser usado para treinamento de IA, criação de perfil comportamental ou revisão humana |

| Falta de criptografia de acesso zero | Conversas podem ser acessadas pela OpenAI e seus parceiros | Aumenta o risco de exposição de dados sensíveis |

| Preocupações regulatórias e de propriedade intelectual | Exposição ao GDPR/HIPAA ou vazamentos de dados proprietários | Responsabilidade legal e consequências financeiras |

| Sistema de código fechado | Transparência limitada sobre o tratamento de dados | Exige confiança na OpenAI |

| Anúncios no aplicativo | Maior rastreamento e criação de perfil | Não está claro como os dados de chat alimentam anúncios personalizados |

Privacidade pessoal

Veja o que você arrisca ao usar o ChatGPT:

- O ChatGPT pode coletar as informações que você insere — como perguntas, respostas e como você interage com a ferramenta — para treinar seus modelos de IA. Se você enviar um currículo, documento jurídico, relatório médico ou outro arquivo com dados pessoais, esse conteúdo também poderá ser armazenado e processado.

- Mesmo que você nunca insira seu nome ou outros dados pessoais, seus prompts podem revelar padrões ao longo do tempo, como preocupações de saúde, dúvidas religiosas, inclinações políticas, situação familiar ou estado emocional. Combinados com seu endereço IP(nova janela) e outros identificadores técnicos, esses padrões podem ser usados para construir perfis comportamentais detalhados.

- Você pode até optar por sair do treinamento de IA, mas suas conversas ainda são registradas e detalhes sensíveis podem ser vistos por revisores humanos se forem sinalizados, como quando você envia feedback.

- Seu histórico de chat é protegido durante o envio e o armazenamento, mas não é protegido com criptografia de acesso zero, então a OpenAI ou terceiros ainda podem acessar suas conversas anteriores.

- Em julho de 2025, milhares de conversas compartilhadas do ChatGPT apareceram em resultados de pesquisa do Google(nova janela), expondo trocas profundamente pessoais que os usuários provavelmente presumiam ser privadas. A OpenAI logo retirou o recurso e disse que estava trabalhando com o Google para desindexar os resultados, mas o incidente destaca como interações com IA podem facilmente cair em domínio público sem que você perceba.

- No início de 2026, a OpenAI introduziu anúncios para usuários do ChatGPT nos planos gratuitos e ChatGPT Go. Apesar das garantias de que os anúncios não influenciarão as respostas nem envolverão o compartilhamento de dados pessoais com anunciantes, a medida segue um padrão bem estabelecido de Big Tech em que a publicidade acaba se tornando normalizada após preocupações iniciais com privacidade.

Risco empresarial

A OpenAI é uma empresa dos EUA, portanto usar o ChatGPT pode levantar preocupações com proteção de dados e riscos de vazamento de informações sensíveis. Se você estiver na Europa ou em outro lugar, seus dados ainda poderão estar sujeitos à jurisdição dos EUA, já que são processados por uma empresa americana. Veja o que isso significa:

- Sem fortes garantias de proteção de dados, sua organização corre risco de multas ou escrutínio regulatório sob leis como o GDPR e a HIPAA(nova janela).

- Você corre risco de vazamentos ao treinar modelos de IA com dados da sua empresa. Por exemplo, funcionários podem inserir código proprietário, contratos confidenciais ou informações de clientes no ChatGPT, potencialmente expondo propriedade intelectual, segredos comerciais ou dados de clientes.

- A OpenAI pode compartilhar dados com parceiros, fornecedores, outros terceiros ou por meio de integrações com aplicativos — que podem ter proteções de privacidade mais fracas ou políticas de dados diferentes. Em 2025, uma violação envolvendo um dos fornecedores de analytics da OpenAI expôs informações identificadoras sobre clientes da API.

- Segundo leis dos EUA como o Patriot Act ou a FISA (Foreign Intelligence Surveillance Act), empresas podem ser obrigadas a fornecer dados a agências governamentais, muitas vezes com ordens de sigilo que as impedem de notificar usuários.

Falta de transparência

Os riscos acima são conhecidos. Mas o que é especialmente arriscado no ChatGPT (e em outros softwares de código fechado) é aquilo que você não tem permissão para saber.

- O código dos aplicativos do ChatGPT não é open source, então não há supervisão pública sobre como ele funciona, o que registra ou como processa seus dados nos bastidores. Você precisa depender das políticas da OpenAI e confiar que o sistema trata os dados com responsabilidade.

- Embora a OpenAI tenha lançado modelos de pesos abertos que podem ser examinados publicamente, os modelos de IA que o ChatGPT usa não são open source, então você não consegue verificar como os dados foram pré-treinados em grandes conjuntos de dados.

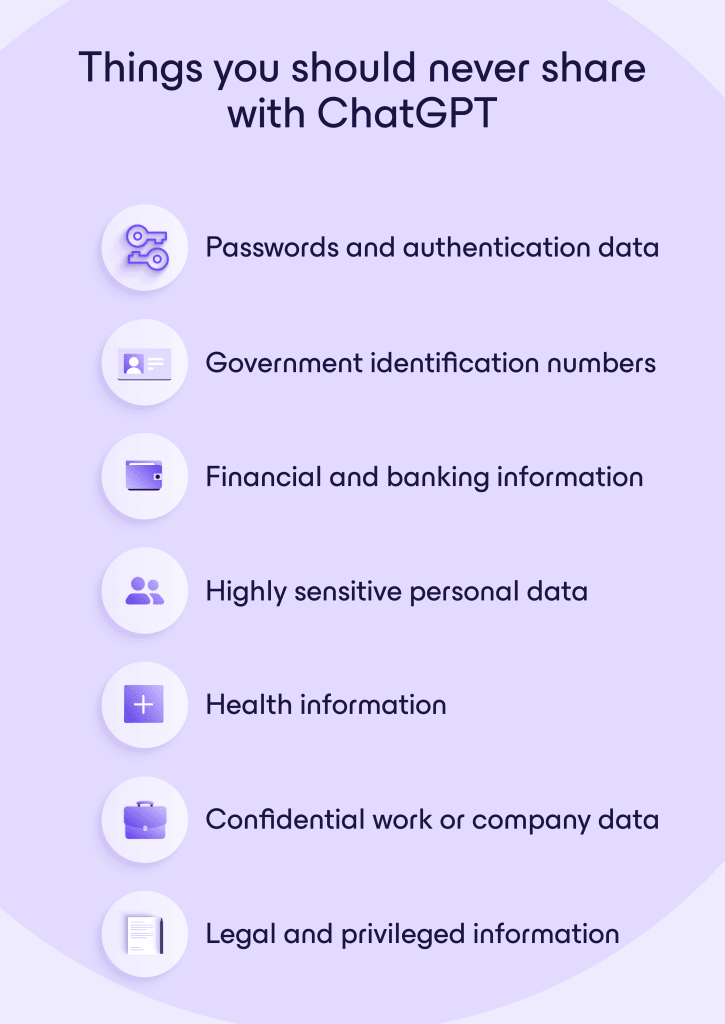

Coisas que você nunca deve compartilhar com o ChatGPT

Embora o ChatGPT possa ser útil, você nunca deve tratá-lo como um cofre seguro para informações sensíveis. Evite inserir qualquer coisa que possa prejudicar você, sua empresa ou outras pessoas se fosse armazenada, revisada ou exposta acidentalmente:

Senhas e dados de autenticação, como senhas de contas, códigos de autenticação de dois fatores (A2F), códigos de autenticação de backup ou chaves privadas de API.

Números de identificação governamental, incluindo previdência social, documento de identidade nacional, passaporte, carteira de motorista e números de identificação fiscal.

Informações financeiras e bancárias, como números de cartão de crédito ou débito, IBANs, credenciais de banco on-line, inícios de sessão de contas de investimento ou chaves privadas de carteiras de Bitcoin.

Dados pessoais altamente sensíveis que poderiam ser usados para identificar ou rastrear você ou sua família, como endereço residencial e número de telefone, data de nascimento ou fotos ou documentos privados.

Informações de saúde, como relatórios médicos, registros de diagnóstico, números de seguro, IDs de pacientes ou históricos detalhados de saúde vinculados à sua identidade.

Dados confidenciais de trabalho ou da empresa, incluindo código-fonte proprietário, documentos internos de estratégia, contratos confidenciais, bancos de dados de clientes, detalhes de clientes, projeções financeiras, relatórios não publicados ou NDAs.

Informações jurídicas e privilegiadas, como comunicações entre advogado e cliente, estratégias de casos jurídicos, documentos de evidências ou discussões confidenciais de acordo.

Como se manter seguro ao usar o ChatGPT

Você não precisa evitar totalmente as ferramentas de IA, mas deve tratá-las como serviços voltados ao público, e não como espaços de trabalho privados. Alguns hábitos simples podem reduzir significativamente seu risco:

- Evite compartilhar informações sensíveis que você não gostaria que fossem armazenadas, revisadas ou expostas publicamente.

- Remova detalhes identificáveis ou substitua-os por marcadores ou exemplos fictícios.

- Envie apenas arquivos que não contenham informações sensíveis ou confidenciais.

- Trate chats de IA como e-mails ou tickets de suporte que poderiam ser vistos por outras pessoas.

- Revise as configurações de privacidade e desative configurações como histórico de chat, memória ou treinamento de IA.

- Exclua conversas de que você não precisa mais para reduzir quanta informação pessoal permanece associada à sua conta.

Mude para um assistente de IA privado

Se você está preocupado em compartilhar informações pessoais ou empresariais com ferramentas de IA, experimente o Lumo. Nossa alternativa privada ao ChatGPT nunca registra suas conversas nem as usa para treinamento de modelos. Seus dados são protegidos com criptografia assimétrica bidirecional (uma forma de criptografia de ponta a ponta) e processados em servidores europeus controlados pela Proton.

Quando você usa o Lumo com uma Conta Proton, suas conversas são protegidas com criptografia de acesso zero, o que significa que somente você pode lê-las — nem mesmo a Proton. Para máxima privacidade, o modo Ghost permite usar o Lumo sem salvar histórico algum.

O Lumo usa modelos open source, então qualquer pessoa pode verificar que não ocorre rastreamento oculto nem coleta de dados.

Experimente o Lumo agora e veja como é uma IA quando sua privacidade é o que mais importa. E quando você estiver pronto para levar esse mesmo nível de privacidade para o seu local de trabalho, o Lumo for Business ajuda sua equipe a colaborar com segurança e se manter produtiva sem comprometer os dados confidenciais da empresa.

Você também pode baixar o Lumo no Google Play(nova janela) ou na App Store(nova janela).