ChatGPT ist ein leistungsstarker KI-Assistent(neues Fenster), der täglich von Millionen von Benutzern verwendet wird, aber ist er sicher? Er wird von OpenAI betrieben, einem der größten Tech-Unternehmen der Welt. Und wie viele Big-Tech-Plattformen sammelt OpenAI große Mengen an Benutzerdaten. Diese Daten sind nicht durch Null-Zugriff-Verschlüsselung geschützt, sodass das Unternehmen sie an Geschäftspartner (einschließlich Werbe- und Analyseunternehmen), die Regierung und Hacker bei einem Datenleck weitergeben kann.

Hinter den Kulissen lernen die großen Sprachmodelle (LLM) von OpenAI ständig aus dem, was du tippst. Sensible Fragen, z. B. nach Krankheitssymptomen, rechtlichen Angelegenheiten oder geistigem Eigentum, können in komplexe Profiling-Systeme einfließen oder dabei helfen, KI-Modelle zu trainieren, die weit über deine ursprüngliche Absicht hinaus verwendet werden.

Die Bedenken darüber, wie KI-Unternehmen mit Benutzerdaten umgehen, wachsen. Im März 2026 verpflichteten sich über 2,5 Millionen Benutzer(neues Fenster), ChatGPT zu verlassen, nachdem eine umstrittene Partnerschaft mit der US-Regierung Fragen darüber aufgeworfen hatte, wie KI-Systeme bereitgestellt und kontrolliert werden. Es ist eine Erinnerung daran, dass du beim Interagieren mit einem KI-Assistenten ohne starken Schutz der Privatsphäre möglicherweise mehr Informationen teilst, als dir bewusst ist.

- Ist ChatGPT sicher? Die Risiken der Nutzung von KI wie ChatGPT und anderer Big Tech

- Dinge, die du niemals mit ChatGPT teilen solltest

- So bleibst du bei der Nutzung von ChatGPT sicher

- Wechsle zu einem privaten KI-Assistenten

Ist ChatGPT sicher? Die Risiken der Nutzung von KI wie ChatGPT und anderer Big Tech

Bevor du dich für KI-Tools wie ChatGPT, Gemini, Meta AI, Copilot und DeepSeek entscheidest, solltest du deren Sicherheit und Risiken für die Privatsphäre kennen:

| Risiko | Mögliche Auswirkungen | Warum das wichtig ist |

| Datenerfassung und -protokollierung | Prompts, Datei-Uploads und Interaktionsmuster können gespeichert werden | Können für KI-Training, Verhaltensprofiling oder menschliche Überprüfungen verwendet werden |

| Mangel an Null-Zugriff-Verschlüsselung | OpenAI und seine Partner können auf Unterhaltungen zugreifen | Erhöht das Risiko, dass sensible Daten preisgegeben werden |

| Regulatorische und IP-Bedenken | GDPR-/HIPAA-Verstöße oder Leaks proprietärer Daten | Rechtliche Haftung und finanzielle Konsequenzen |

| Closed-Source-System | Eingeschränkte Transparenz bei der Datenverarbeitung | Erfordert Vertrauen in OpenAI |

| In-App-Werbung | Verstärktes Tracking und Profiling | Unklar, wie Chat-Daten personalisierte Werbung beeinflussen |

Persönliche Privatsphäre

Das riskierst du, wenn du ChatGPT nutzt:

- ChatGPT sammelt möglicherweise die Informationen, die du eingibst – wie Fragen, Antworten und wie du mit dem Tool interagierst –, um seine KI-Modelle zu trainieren. Wenn du einen Lebenslauf, ein juristisches Dokument, einen medizinischen Bericht oder eine andere Datei mit persönlichen Daten hochlädst, können diese Inhalte ebenfalls gespeichert und verarbeitet werden.

- Selbst wenn du niemals deinen Namen oder andere persönliche Daten eingibst, können deine Prompts im Laufe der Zeit Muster wie gesundheitliche Bedenken, religiöse Zweifel, politische Neigungen, Familienstand oder deinen emotionalen Zustand offenbaren. In Kombination mit deiner IP-Adresse(neues Fenster) und anderen technischen Kennungen können diese Muster verwendet werden, um detaillierte Verhaltensprofile zu erstellen.

- Du kannst dich zwar möglicherweise vom KI-Training abmelden, aber deine Unterhaltungen werden weiterhin protokolliert und sensible Details können von menschlichen Prüfern eingesehen werden, wenn sie markiert werden, z. B. wenn du Feedback einreichst.

- Dein Chat-Verlauf ist geschützt, während er gesendet und gespeichert wird, aber er ist nicht mit Null-Zugriff-Verschlüsselung geschützt, sodass OpenAI oder ein Dritter weiterhin auf deine vergangenen Unterhaltungen zugreifen kann.

- Im Juli 2025 erschienen tausende geteilte ChatGPT-Unterhaltungen in den Google-Suchergebnissen(neues Fenster) und offenbarten zutiefst persönliche Austausche, von denen die Benutzer wahrscheinlich annahmen, dass sie privat seien. OpenAI zog die Funktion bald zurück und gab an, mit Google an der Deindexierung der Ergebnisse zu arbeiten, aber der Vorfall macht deutlich, wie leicht KI-Interaktionen in die öffentliche Domain rutschen können, ohne dass du es merkst.

- Anfang 2026 führte OpenAI Werbung für ChatGPT-Benutzer in den kostenlosen und ChatGPT Go-Abonnements ein. Trotz der Zusicherung, dass Werbung die Antworten nicht beeinflusst oder das Teilen persönlicher Daten mit Werbetreibenden beinhaltet, folgt der Schritt einem gut etablierten Big-Tech-Muster, bei dem Werbung nach anfänglichen Bedenken hinsichtlich der Privatsphäre schließlich normalisiert wird.

Geschäftsrisiko

OpenAI ist ein US-Unternehmen, daher kann die Nutzung von ChatGPT Datenschutzbedenken aufwerfen und das Risiko bergen, dass sensible Informationen in einem Leak landen. Wenn du in Europa oder woanders ansässig bist, könnten deine Daten dennoch der US-Gerichtsbarkeit unterliegen, da sie von einem US-Unternehmen verarbeitet werden. Das bedeutet Folgendes:

- Ohne starke Datenschutzgarantien riskiert deine Organisation Geldstrafen oder behördliche Untersuchungen nach Gesetzen wie GDPR und HIPAA(neues Fenster).

- Du riskierst Leaks, indem du KI-Modelle mit deinen Unternehmensdaten trainierst. Mitarbeiter könnten beispielsweise proprietären Code, vertrauliche Verträge oder Kundeninformationen in ChatGPT eingeben, was möglicherweise geistiges Eigentum, Geschäftsgeheimnisse oder Kundendaten preisgibt.

- OpenAI teilt möglicherweise Daten mit Partnern, Anbietern, anderen Dritten oder über App-Integrationen – was schwächere Schutzmaßnahmen für die Privatsphäre oder andere Datenrichtlinien haben könnte. Im Jahr 2025 legte ein Datenleck bei einem von OpenAIs Analyseanbietern identifizierende Informationen über API-Kunden offen.

- Nach US-Gesetzen wie dem Patriot Act oder dem FISA (Foreign Intelligence Surveillance Act) können Unternehmen gezwungen werden, Daten an Regierungsbehörden weiterzugeben, oft mit Geheimhaltungsanordnungen, die sie daran hindern, die Benutzer zu benachrichtigen.

Mangelnde Transparenz

Dies sind bekannte Risiken. Aber was an ChatGPT (und anderer Closed-Source-Software) besonders riskant ist, ist das, was du nicht wissen darfst.

- Der Code der Apps von ChatGPT ist nicht Open Source, daher gibt es keine öffentliche Kontrolle darüber, wie er funktioniert, was er protokolliert oder wie er deine Daten hinter den Kulissen verarbeitet. Du musst dich auf die Richtlinien von OpenAI verlassen und darauf vertrauen, dass das System verantwortungsvoll mit Daten umgeht.

- Obwohl OpenAI Open-Weight-Modelle veröffentlicht hat, die öffentlich untersucht werden können, sind die KI-Modelle, die ChatGPT verwendet, nicht Open Source, sodass du nicht überprüfen kannst, wie die Daten auf großen Datensätzen vortrainiert wurden.

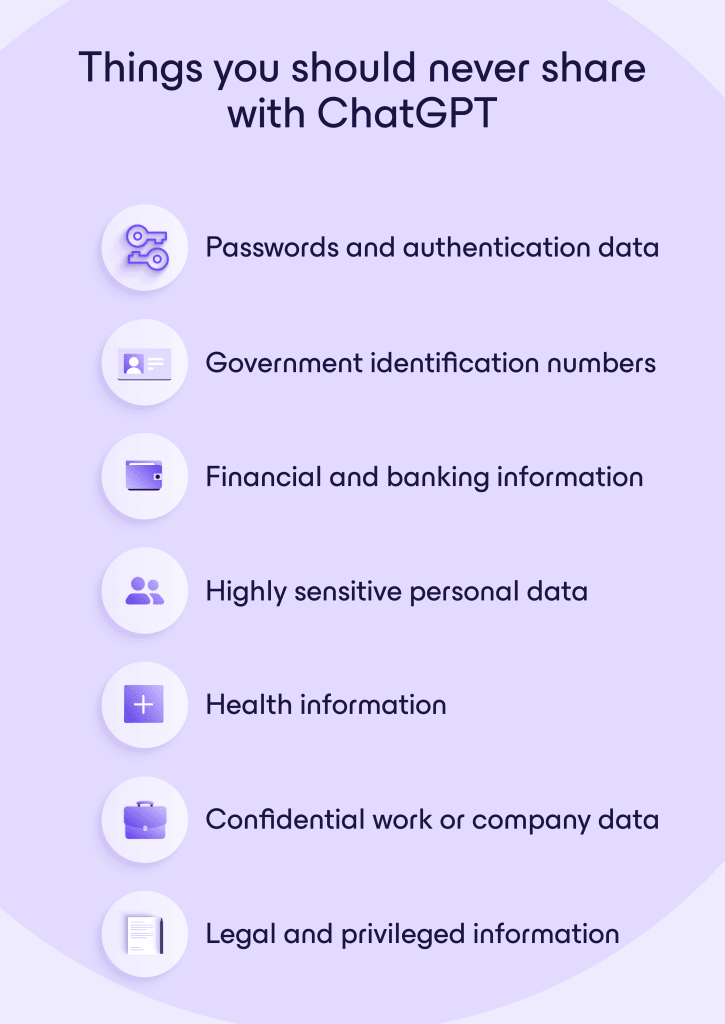

Dinge, die du niemals mit ChatGPT teilen solltest

Auch wenn ChatGPT hilfreich sein kann, solltest du es niemals wie einen sicheren Tresor für sensible Informationen behandeln. Vermeide es, etwas einzugeben, das dir, deinem Unternehmen oder anderen schaden könnte, wenn es gespeichert, überprüft oder versehentlich offengelegt wird:

Passwörter und Authentifizierungsdaten, wie Kontopasswörter, Codes für die Zwei-Faktor-Authentifizierung (2FA), Sicherungs-Authentifizierungscodes oder private API-Schlüssel.

Behördliche Identifikationsnummern, einschließlich Sozialversicherungsnummern, Personalausweisen, Reisepässen, Führerscheinen und Steueridentifikationsnummern.

Finanz- und Bankinformationen, wie Kredit- oder Debitkartennummern, IBANs, Anmeldedaten für das Online-Banking, Kontoanmeldungen für Investitionen oder private Schlüssel für dein Bitcoin-Wallet.

Hochsensible persönliche Daten, die verwendet werden könnten, um dich oder deine Familie zu identifizieren oder zu verfolgen, wie z. B. Privatadresse und Telefonnummer, Geburtsdatum oder private Fotos oder Dokumente.

Gesundheitsinformationen, wie medizinische Berichte, Diagnoseunterlagen, Versicherungsnummern, Patienten-IDs oder detaillierte Gesundheitsverläufe, die an deine Identität gebunden sind.

Vertrauliche Arbeits- oder Unternehmensdaten, einschließlich proprietärem Quellcode, internen Strategiedokumenten, vertraulichen Verträgen, Kundendatenbanken, Kunden-Details, Finanzprognosen, unveröffentlichten Berichten oder NDAs.

Rechtliche und privilegierte Informationen, wie Kommunikation zwischen Anwalt und Mandant, Strategien für Rechtsfälle, Beweisdokumente oder vertrauliche Vergleichsverhandlungen.

So bleibst du bei der Nutzung von ChatGPT sicher

Du musst KI-Tools nicht komplett meiden, solltest sie aber eher wie öffentliche Dienste als wie private Arbeitsbereiche behandeln. Ein paar einfache Gewohnheiten können dein Risiko erheblich reduzieren:

- Vermeide es, sensible Informationen zu teilen, von denen du nicht möchtest, dass sie gespeichert, überprüft oder öffentlich offengelegt werden.

- Entferne identifizierende Details oder ersetze sie durch Platzhalter oder fiktive Beispiele.

- Lade nur Dateien hoch, die keine sensiblen oder vertraulichen Informationen enthalten.

- Behandle KI-Chats wie E-Mails oder Support-Tickets, die von anderen Personen gesehen werden könnten.

- Überprüfe deine Privatsphäre-Einstellungen und deaktiviere Einstellungen wie den Chat-Verlauf, das Gedächtnis oder das KI-Training.

- Lösche Unterhaltungen, die du nicht mehr benötigst, um die Menge an persönlichen Informationen zu reduzieren, die mit deinem Konto verknüpft bleiben.

Wechsle zu einem privaten KI-Assistenten

Wenn du Bedenken hast, persönliche oder geschäftliche Informationen mit KI-Tools zu teilen, probiere Lumo aus. Unsere private ChatGPT-Alternative protokolliert niemals deine Unterhaltungen oder verwendet sie für das Modelltraining. Deine Daten sind durch bidirektionale asymmetrische Verschlüsselung (eine Form der Ende-zu-Ende-Verschlüsselung) geschützt und werden auf europäischen Servern verarbeitet, die von Proton kontrolliert werden.

Wenn du Lumo mit einem Proton-Konto nutzt, sind deine Unterhaltungen mit Null-Zugriff-Verschlüsselung geschützt, was bedeutet, dass nur du sie lesen kannst – nicht einmal Proton. Für maximale Privatsphäre ermöglicht dir der Ghost-Modus, Lumo zu nutzen, ohne überhaupt einen Verlauf zu speichern.

Lumo verwendet Open-Source-Modelle, sodass jeder überprüfen kann, dass kein verstecktes Tracking oder keine Datenerfassung stattfindet.

Probiere Lumo jetzt aus und erlebe, wie KI aussieht, wenn deine Privatsphäre an erster Stelle steht. Und wenn du bereit bist, das gleiche Maß an Privatsphäre an deinen Arbeitsplatz zu bringen, hilft Lumo for Business deinem Team dabei, sicher zusammenzuarbeiten und produktiv zu bleiben, ohne sensible Unternehmensdaten zu gefährden.

Du kannst Lumo auch bei Google Play(neues Fenster) oder im App Store(neues Fenster) herunterladen.