ChatGPT est un puissant assistant d’IA(nouvelle fenêtre) utilisé par des millions d’utilisateurs quotidiennement, mais est-il sûr à utiliser ? Il est détenu et exploité par OpenAI, l’une des plus grandes entreprises technologiques au monde. Et comme de nombreuses plateformes Big Tech, OpenAI collecte de grandes quantités de données d’utilisateur. Ces données ne sont pas protégées par un chiffrement sans accès, l’entreprise peut donc les divulguer à des partenaires commerciaux (y compris des sociétés de publicité et d’analyse), au gouvernement et aux pirates informatiques dans l’événement de fuites de données.

En coulisses, les grands modèles de langage (LLM) d’OpenAI apprennent constamment de ce que vous saisissez. Des questions sensibles, comme des questions sur des symptômes de santé, des questions juridiques ou la propriété intellectuelle, peuvent alimenter des systèmes complexes de profilage ou contribuer à entraîner des modèles d’IA utilisés bien au-delà de votre intention initiale.

L’inquiétude concernant la manière dont les entreprises d’IA manipulent un nom d’utilisateur et ses données augmente. En mars 2026, plus de 2,5 millions d’utilisateurs(nouvelle fenêtre) se sont engagés à quitter ChatGPT après qu’un partenariat controversé avec le gouvernement américain a soulevé des questions sur la manière dont les systèmes d’IA se voient déployer et gouverner. C’est un rappel que lorsque vous interagissez avec un assistant d’IA sans de solides protections du respect de la vie privée, vous pouvez partager plus d’informations que vous ne le réalisez.

- ChatGPT est-il sûr ? Les risques de l’utilisation de l’IA comme ChatGPT et d’autres Big Tech

- Ce que vous ne devriez jamais partager avec ChatGPT

- Comment rester en sécurité lors de l’utilisation de ChatGPT

- Passer à un assistant d’IA privé

ChatGPT est-il sûr ? Les risques de l’utilisation de l’IA comme ChatGPT et d’autres Big Tech

Avant de choisir des outils d’IA comme ChatGPT, Gemini, Meta AI, Copilot et DeepSeek, il vaut la peine de comprendre leurs risques en matière de sécurité et de respect de la vie privée :

| Risque | Impact potentiel | Pourquoi c’est important |

| Collecte de données et journalisation | Les invites, les actions visant à importer un fichier et les modèles d’interaction peuvent être au statut stocké | Peut être utilisé pour l’entraînement de l’IA, le profilage comportemental ou l’examen humain |

| Absence de chiffrement zéro accès | La conversation peut être l’objet d’un acte permettant d’y accéder par OpenAI et ses partenaires | Augmente le risque d’exposition des données sensibles |

| Préoccupations réglementaires et de propriété intellectuelle | Exposition GDPR/HIPAA ou fuite de données propriétaires | Responsabilité juridique et conséquences financières |

| Système à source fermée | Transparence limitée sur la manipulation des données | Nécessite de faire confiance à OpenAI |

| Publicités intégrées à l’application | Suivi et profilage accrus | Il n’est pas clair comment les données de chat informent les publicités personnalisées |

Respect de la vie privée personnelle

Voici ce que vous risquez en utilisant ChatGPT :

- ChatGPT peut collecter les informations que vous souhaitez saisir — telles que les questions, les réponses et la façon dont vous interagissez avec l’outil — pour entraîner ses modèles d’IA. Si vous choisissez d’importer et reprendre un document juridique, un rapport médical ou un autre fichier avec des données personnelles, ce contenu peut également être au statut stocké et traité.

- Même si vous décidez de ne jamais saisir votre nom ou d’autres données personnelles, vos invites peuvent révéler des modèles au fil du temps, tels que des problèmes de santé, des doutes religieux, des tendances politiques, la situation familiale ou l’état émotionnel. Combinés à votre adresse IP(nouvelle fenêtre) et à d’autres identifiants techniques, ces modèles peuvent être utilisés pour construire des profils comportementaux détaillés.

- Vous pourrez peut-être vous désinscrire de l’entraînement de l’IA, mais votre conversation est toujours enregistrée dans le journal et des informations sensibles pourraient être vues par des examinateurs humains si elles sont signalées, par exemple lorsque vous soumettez un commentaire.

- Votre historique de discussion est protégé pendant qu’il va être envoyer et au statut stocké, mais il n’est pas protégé par un chiffrement sans accès, de sorte qu’OpenAI ou un tiers peut toujours accéder à votre conversation passée.

- En juillet 2025, des milliers de conversations ChatGPT qu’on a pu partager sont apparues dans les résultats de recherche de Google(nouvelle fenêtre), exposant des échanges profondément de nature privé que l’utilisateur supposait probablement confidentiels. OpenAI a rapidement retiré la fonctionnalité et a déclaré travailler avec Google pour désindexer les résultats, mais l’incident souligne la facilité avec laquelle les interactions avec l’IA peuvent glisser dans le domaine public sans que vous vous en rendiez compte.

- Début 2026, OpenAI a introduit des publicités pour les utilisateurs de ChatGPT sur les abonnements gratuits et ChatGPT Go. Malgré les assurances que les publicités n’influenceront pas les réponses ou n’impliqueront pas de partager des données personnelles avec les annonceurs, cette décision suit un modèle bien établi de la Big Tech dans lequel la publicité finit par se normaliser après des préoccupations initiales concernant le respect de la vie privée.

Risque commercial

OpenAI est une entreprise américaine, l’utilisation de ChatGPT peut donc soulever des préoccupations en matière de protection des données et des risques de fuite d’informations sensibles. Si vous êtes basé en Europe ou ailleurs, vos données pourraient toujours être l’objet d’une soumission à la juridiction américaine puisqu’elles sont traitées par une entreprise américaine. Voici ce que cela signifie :

- Sans garanties solides en matière de protection des données, votre organisation s’expose à des amendes ou à un examen réglementaire en vertu de lois telles que le GDPR et l’HIPAA(nouvelle fenêtre).

- Vous risquez une fuite en entraînant des modèles d’IA sur les données de votre entreprise. Par exemple, les employés pourraient saisir un code propriétaire, des contrats confidentiels ou des informations clients dans ChatGPT, exposant potentiellement la propriété intellectuelle, des secrets commerciaux ou des données clients.

- OpenAI peut partager des données avec des partenaires, des fournisseurs, d’autres tiers ou via des intégrations d’applications — qui pourraient avoir des protections du respect de la vie privée plus faibles ou des politiques de données différentes. En 2025, une fuite de données impliquant l’un des fournisseurs d’analyse d’OpenAI a exposé des informations d’identification concernant les clients de l’API.

- En vertu de lois américaines telles que le Patriot Act ou le FISA (Foreign Intelligence Surveillance Act), les entreprises peuvent être contraintes de fournir des données aux agences gouvernementales, souvent avec des ordonnances de secret qui les empêchent d’en informer l’utilisateur.

Manque de transparence

Ce qui précède sont des risques connus. Mais ce qui est particulièrement risqué avec ChatGPT (et d’autres logiciels à source fermée), c’est ce que vous n’êtes pas autorisé à savoir.

- Le code de l’application de ChatGPT n’est pas open source, il n’y a donc pas de surveillance publique sur la façon dont il fonctionne, ce qu’il consigne dans le journal ou comment il traite vos données en coulisses. Vous devez vous fier à la politique d’OpenAI et faire confiance au système pour utiliser un nom d’utilisateur et ses données de manière responsable.

- Bien qu’OpenAI ait publié des modèles à poids ouverts qui peuvent être examinés publiquement, les modèles d’IA utilisés par ChatGPT ne sont pas open source, vous ne pouvez donc pas vérifier comment les données ont été pré-entraînées sur de vastes ensembles de données.

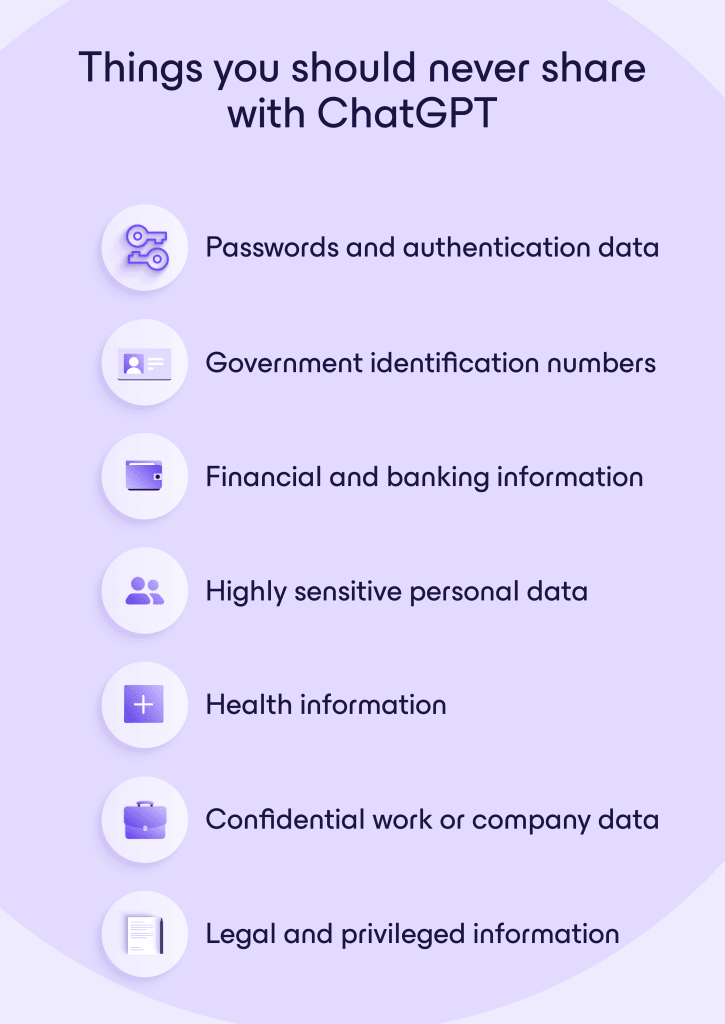

Ce que vous ne devriez jamais partager avec ChatGPT

Même si ChatGPT peut être utile, vous ne devriez jamais le traiter comme un coffre-fort sécurisé pour des informations sensibles. Évitez de saisir quoi que ce soit qui pourrait vous nuire, nuire à votre entreprise ou à d’autres si cela devait être au statut stocké, examiné ou accidentellement exposé :

Mot de passe et données d’authentification, tels que le mot de passe de compte, le code d’authentification à deux facteurs (A2F), le code d’authentification de sauvegarde ou les clés d’API de nature privée.

Numéros d’identification gouvernementaux, y compris la sécurité sociale, la carte d’identité nationale, le passeport, le permis de pilote automobile et les numéros d’identification fiscale.

Informations financières et bancaires, telles que les numéros de carte de crédit ou de débit, les IBAN, les identifiants de banque en ligne, les identifiants de compte d’investissement ou les clés privées de portefeuille Bitcoin.

Informations financières et bancaires, telles que les numéros de crédit ou de carte de débit, les IBAN, les identifiants bancaires en ligne, les identifiants de compte d’investissement ou la clé privée de portefeuille Bitcoin.

Données personnelles hautement sensibles qui pourraient être utilisées pour vous identifier ou vous suivre, vous ou votre famille, telles que l’adresse personnelle et le numéro de téléphone, la date de naissance, ou des photos ou documents de nature privée.

Informations sur la santé, telles que les rapports médicaux, les dossiers de diagnostic, les numéros d’assurance, les identifiants des patients ou les antécédents médicaux détaillés liés à votre identité.

Données professionnelles ou d’entreprise confidentielles, y compris le code source propriétaire, les documents de stratégie interne, les contrats confidentiels, les bases de données clients, les informations sur les clients, les projections financières, les rapports non publiés ou les NDA.

Informations juridiques et privilégiées, telles que les communications avocat-client, les stratégies de dossiers juridiques, les documents de preuve ou les discussions de règlement confidentielles.

Vous n’avez pas à éviter complètement les outils d’IA, mais vous devriez les traiter comme des services publics plutôt que comme des espaces de travail privés. Quelques habitudes simples peuvent considérablement réduire vos risques :

- Évitez de partager des informations sensibles que vous ne voudriez pas voir stockées, examinées ou exposées publiquement.

- Retirez les informations d’identification ou remplacez-les par des espaces réservés ou des exemples fictifs.

- N’importez que des fichiers qui ne contiennent pas d’informations sensibles ou confidentielles.

- Traitez les chats d’IA comme des messages ou des tickets de support qui pourraient être vus par d’autres personnes.

- Examinez les paramètres de confidentialité et désactivez des paramètres tels que l’historique des discussions, la mémoire ou l’entraînement de l’IA.

- Supprimez les conversations dont vous n’avez plus besoin pour réduire la quantité d’informations personnelles qui restent associées à votre compte.

Passez à un assistant IA privé

Si vous craignez de partager des informations personnelles ou professionnelles avec des outils d’IA, essayez Lumo. Notre alternative privée à ChatGPT n’enregistre jamais vos conversations et ne les utilise pas pour l’entraînement de modèles. Vos données sont protégées par un chiffrement asymétrique bidirectionnel (une forme de chiffrement de bout en bout) et traitées sur des serveurs européens contrôlés par Proton.

Lorsque vous utilisez Lumo avec un compte Proton, vos conversations sont protégées par un chiffrement zéro accès, ce qui signifie que vous seul pouvez les lire — pas même Proton. Pour un respect de la vie privée maximal, le mode Fantôme vous permet d’utiliser Lumo sans enregistrer aucun historique.

Lumo utilise des modèles open source, de sorte que tout le monde peut vérifier qu’aucun suivi caché ou collecte de données n’a lieu.

Essayez Lumo dès maintenant et découvrez à quoi ressemble l’IA lorsque le respect de votre vie privée est primordial. Et lorsque vous serez prêt à apporter ce même niveau de respect de la vie privée à votre lieu de travail, Lumo for Business aidera votre équipe à collaborer en toute sécurité et à rester productive sans compromettre les données sensibles de l’entreprise.

Vous pouvez également télécharger l’application Lumo sur Google Play(nouvelle fenêtre) ou l’App Store(nouvelle fenêtre).